https:arxiv.org/abs/2211.06088

https://github.com/ChengpengChen/RepGhost

作者通过结构重参数机制实现特征复用,赋能GhostNet达成硬件友好方案RepGhostNet。ImageNet与COCO基线任务验证了所提方案的有效性与高效性。可参考下图,比MobileOne、MobileNeXt等轻量型架构都要“秀”!速览版请手下!

出发点

GhostNet通过引入cheap操作进行特征复用,但引入了硬件不友好的Concat,即Concat特征复用虽然是无参、无FLOPs,但其计算耗时却不能忽视,见上图。那么如何更高效的进行特征复用呢?结构重参数!!!

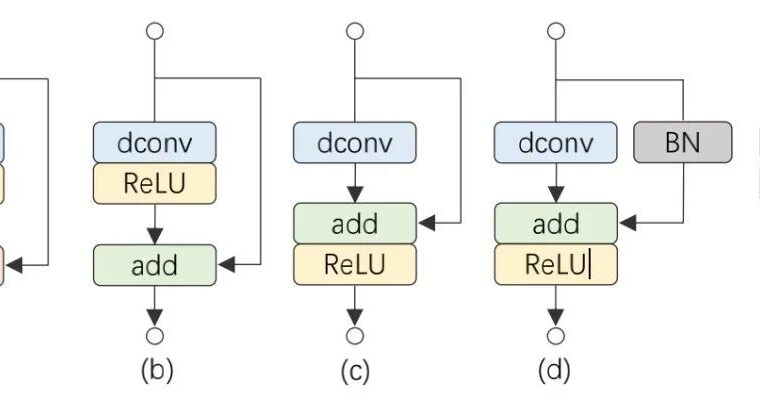

上图给出了Ghost到RepGhost的进化过程,包含以下三点:

-

Concat替换为Add以降低耗时;

-

ReLU迁移以符合重参数折叠机制;

-

shortcut分支引入BN进一步提升非线性。

上图给出了Bottleneck改进过程:主要体现在通道数,这是因为Concat到Add的过渡会导致通道数发生变换。作者主要是针对中间通道数进行调整,而输入与输出通道数相同。

本文实验

下面两个表给出了ImageNet与COCO数据集上的性能对比,在轻量化方面RepGhost还是很不错的,Flops基本在300M以内。

推荐阅读

-

优于ConvNeXt,南开&清华开源基于大核注意力的VAN架构

-

CVPR2022 | RepLKNet: 大核卷积+结构重参数让CNN再次伟大

-

RepVGG|让你的ConVNet一卷到底,plain网络首次超过80%top1精度

-

Timm助力ResNet焕发“第二春”,无蒸馏且无额外数据,性能高达80.4%

-

Apple提出更小、更快、更高性能的端侧实时Transformer类轻量型MobileViT

-

MobileNeXt来了!打破常规,逆残差模块超强改进,精度速度双超MobileNetV2

-

“文艺复兴” ConvNet卷土重来,压过Transformer!FAIR重新设计纯卷积新架构

-

Transformer的终章还是新起点?颜水成团队新作:MetaFormer才是你真正需要的

-

CVPR2021|“无痛涨点”的ACNet再进化,清华大学&旷视科技提出Inception类型的DBB

本文来自微信公众号“AIWalker”(ID:happyaiwalker)。大作社经授权转载,该文观点仅代表作者本人,大作社平台仅提供信息存储空间服务。